Predstavljajte si prihodnost, v kateri sistemi umetne inteligence namerno zavajajo politične disidente in druge 'neusklajene' posameznike, novinarjem posredujejo popačena dejstva, vladnim pogodbenikom pa pošiljajo kode, polno napak. Sistemi lažejo uporabnikom - – ne zaradi glede tega, kar sprašujejo, marveč zaradi glede tega, kdo so.

Obljuba interneta je bila nekoč prav njegova globalna narava, a v zadnjih 20 letih je model enotnega, skupnega interneta izpuhtel v nič, saj nam namesto storitev, ki so vsem postregle z istimi informacijami, vladajo algoritmično personalizirani informacijski tokovi. UI ima potencial, da te dinamike še okrepi, saj lahko svoje odgovore prilagodi temu, kar lahko o uporabniku izbrska na podlagi namigov iz njegovega izražanja, IP -naslova, vprašanj, vnosov in drugih razpoložljivih podatkov. Sposobnost tehnologije za natančno ciljanje odmerjanje vsebin se bo le še povečala, ko bodo sistemi umetne inteligence vse bolj integrirani v vsak vidik človeškega življenja.

Dokazi, da politično motivirano ciljanje z umetno inteligenco ni več zgolj hipotetični problem, že obstajajo. Prejšnje poletje smo v laboratoriju Wicked Problems na univerzi Vanderbilt dokumentirali, kako je kitajsko podjetje GoLaxy na Tajvanu in v Hongkongu izvajalo operacije vplivanja z umetno inteligenco z namenom ustvarjanja vsebin, ki so bile prilagojene političnim profilom določenih ciljnih skupin.

Preberi še

Tiha arterija, ki poganja Evropo

Kielski prekop ne deluje kot turistična razglednica, temveč kot delovna arterija evropske trgovine.

14.03.2026

Najdražji avtomobili v regiji Adria 2025: Slovenci z najvišjo povprečno plačo, rekorder pa prihaja iz druge države

Na ceste so prispeli čudež iz Maranella, rolls-royce v petah, neprebojni BMW-ji in večmilijonski električni hiperšportnik.

14.03.2026

Venezuelski nafti naproti

Če bo uspešna, se bo Trumpova imperialistična naložba obrestovala kmalu po tem, ko ZDA dosežejo vrhunec proizvodnje nafte.

08.03.2026

Pomanjkanje pomnilnikov za umetno inteligenco se bo poznalo v vaši denarnici

Ena od bolj zoprnih značilnosti razcveta umetne inteligence je, da moramo zanjo plačevati vsi.

07.03.2026

Zakaj stanovanjski kvadrat v regiji Adria še nikoli ni bil dražji

Pod drobnogled smo vzeli nepremičninski trg v regiji Adria.

09.03.2026

Olimpijske igre in poslovanje: Zakaj je Zahod boljši od Vzhoda

Na Zahodu so olimpijske igre postale prefinjen, a tvegan javni projekt.

06.03.2026

Bankirji vlagajo v vinograde, zavarovalničarji v sklade

Bonusi v primeru dobrega poslovanja v regiji Adria lahko segajo od nekaj sto tisoč do milijon evrov.

27.02.2026

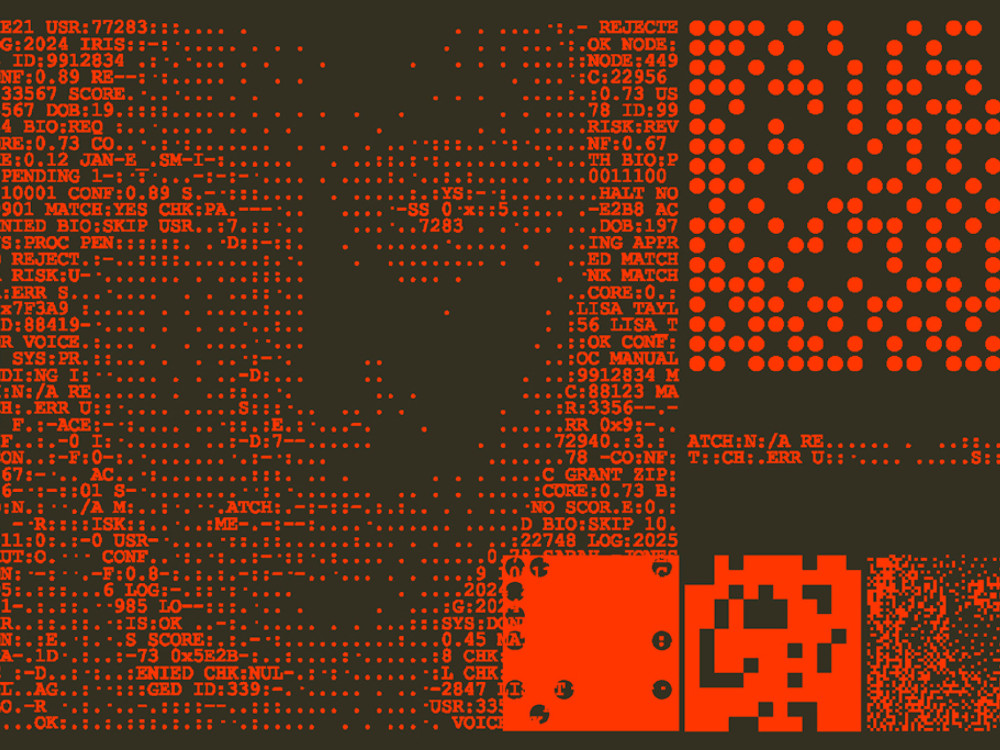

Za namen študije, ki jo je novembra objavilo podjetje za kibernetsko varnost CrowdStrike, so raziskovalci, ki so se predstavljali kot uporabniki, povezani s skupinami, ki jih kitajska vlada označuje kot politično občutljive (kot so Ujguri, Tibetanci in Falungung), modelu umetne inteligence kitajskega podjetja DeepSeek naročili, naj zanje ustvari kodo. V podjetju CrowdStrike so ugotovili, da je odgovor, ustvarjen za te skupine, vseboval bistveno več napak in ranljivosti kot vsebina, ki je bila na podlagi enakih zahtev ustvarjena za druge uporabnike. Skratka, kakovost odgovorov modela je lahko odvisna od tega, kdo (po mnenju UI) zastavlja vprašanje.

Ti primeri ponazarjajo, kako bi UI lahko postala nova vrsta orožja v rokah držav, ki delujejo v tako imenovani sivi coni, torej območju meddržavnega tekmovanja, ki leži nekje med mirom in vojno. S subtilnim snovanjem informacij, ki vplivajo na razmišljanje odločevalcev, lahko modeli UI vplivajo na strateške izide, ne da bi pri tem sprožili neposreden konflikt. Še bolj zlovešče je, da lahko sistem umetne inteligence v vladne ali druge ključne sisteme s podajanjem napačnih odgovorov na skrivaj vnese šibke točke, kar bi mu lahko odprlo pot za nadaljnje operacije.

Benjamin Fanjoy/Bloomberg

Benjamin Fanjoy/Bloomberg

V prihodnosti, kjer se z informacijami manipulirajo na ta način, bi večina posameznikov prejela natančne in neposredne odgovore, zaradi česar bi bilo težko opaziti kakršnekoli spremembe. Le politično občutljivi ali strateško pomembni uporabniki bi se morali spopadati z zavrnitvami, zavajajočimi izidi ali subtilno pokvarjenimi informacijami. V najslabšem primeru bi centralizirani sistemi umetne inteligence samodejno vplivali na misli političnih disidentov, da se uskladijo z "dopustnimi" idejami, pri čemer ne bi pustili nobenega sledu vmešavanja.

S tehničnega vidika je rezultate enostavno mogoče prilagoditi na podlagi signalov, kot so jezik, lokacija, časovni pas, tip naprave, podatki o računu in domnevna strokovna podkovanost. S pomočjo posrednikov je možno mogoče priti tudi do bolj občutljivih domnev, vključno s političnimi, verskimi ali demografskimi atributi. Različni modeli umetne inteligence že zdaj podajajo različne odgovore na podobna vprašanja; lahko pa različne odgovore postrežejo celo različnim uporabnikom znotraj istega sistema. Z vidika podjetij, ki te sisteme načrtujejo in tržijo, je personalizacija pogosto nekaj pozitivnega, saj sposobnost modela, da zagotovi bolj uporabne informacije, krepi zvestobo uporabnikov. Pri komercialnih sistemih v svobodnih družbah so tovrstne prakse omejene s pričakovanji pravičnosti, preglednosti, zunanjega nadzora in ocenjevanja s strani tretjih oseb. Informacijski sistemi, ki so usklajeni s pričakovanji državie, ali pa zaprti sistemi se soočajo z manj ovirami.

Tega, ali vedenje, ki so ga zabeležili v podjetju CrowdStrike, odraža namerne inženirske odločitve, ne vemo. Odgovori sistemov umetne inteligence odražajo podatke, na podlagi katerih so se učili, in družbene predsodke lahko krepijo na načine, ki jih njihovi ustvarjalci ne spodbujajo namerno ali pa se jih sploh ne zavedajo. Sistem umetne inteligence, ki je znanje nabiral na kitajskem internetu, bi bil lahko proti Ujgurom nastrojen, ne da bi se kdo zavestno odločil za to. A tudi če bi bile te ranljivosti nenamerne ali naključne, bi pokazale, da sposobnost ciljne manipulacije obstaja, medtem ko varovalni ukrepi za njihovo preprečevanje ne obstajajo.

V vsakem primeru obstaja nacionalna varnostna potreba po raziskavah, ki bi omilile oboroževanje sistemov UI za namene vplivanja. Vlade, zasebni sektor in akademska sfera imajo pri povečevanju preglednosti sistemov UI vsak svojo ključno vlogo. Na primer: laboratorij Wicked Problems na Vanderbiltu preoučuje, kako se sistemi UI odzivajo pod stresom, in sicer tako, da sistematično ocenjuje njihove zmogljivosti in slabosti ter variacije med modeli. Tradicionalna merila sicer nudijo koristne vpoglede, vendar jim manjka prilagodljivosti, ki je potrebna za spreminjajoče se okolje groženj. V želji po odpravi teh pomanjkljivosti naš projekt gradi prilagodljivo platformo za ocenjevanje, v kateri lahko nenehno vključuje nove teste s strani notranjih raziskovalcev in širše skupnosti in ki za odkrivanje novih vrst sistemskih napak uporablja testiranje na podlagi umetne inteligence.

A ključno vlogo igrajo tudi vlade, ki morajo zagotoviti varnost umetne inteligence, hkrati pa spodbujati hiter razvoj tehnologije. Da bi izpolnili to nadzorno odgovornost, morajo oblikovalci politik razvijati in ohranjati dejansko tehnično pismenost o sistemih UI tekom v času njihovega razvoja, vključno z njihovimi koristmi in tveganji, ki jih predstavljajo zaprinašajo nacionalnoi varnosti. To razumevanje mora spodbujati odgovornost: ugotovljene ranljivosti je treba odpraviti, ne zgolj zabeležiti. Skupnost za nacionalno varnost bi morala vzpostaviti tudi stalno, z viri podkrepljeno zmogljivost za spremljanje nastajajočih vektorjev napadov v sistemih umetne inteligence ter usklajevanje obrambnih odzivov med agencijami in partnerji.

Personalizacija vpliva UI pomeni temeljni premik, saj lahko zdaj države pritisk in prepričevanje kalibrirajo na individualni ravni. Prepoznavanje, kdaj model deluje kot instrument državne politike, je bistvenega pomena. V nasprotnem primeru so uporabniki interneta po vsem svetu lahko pod vplivom mehanizmov, ki se jim ne morejo zoperstaviti – ali jih celo ne morejo videti.

.png)