Ali bi morale vlade moderirati spletne vsebine? Nekateri menijo, da bi moralo biti tako, pri tem pa se sklicujejo na varnost. Drugi pravijo ne in v ospredje postavljajo svobodo govora. Tretje najbolj skrbi točnost informacij. Vsi ti pogledi so legitimni, vendar noben enoten odgovor ne more zadovoljiti vseh, meni Ilija Bogunović, docent za umetno inteligenco in strojno učenje na University College London (UCL).

Če želimo resnično povzeti kompleksnost človeških vrednot in ciljev, pravi Bogunović na konferenci Sustainable Strategies Bloomberg Adria, moramo modele trenirati s podatki, ki odražajo različne poglede.

Po njegovih besedah je standardni postopek za usklajevanje velikih jezikovnih modelov precej enostaven. "Začnemo s predhodno naučenim velikim jezikovnim modelom (LLM), ki je bil treniran na ogromnih količinah podatkov za 'učenje' jezika, nato pa ga dodatno treniramo, da postane bolj uporaben in bolje usklajen s človeškimi vrednotami."

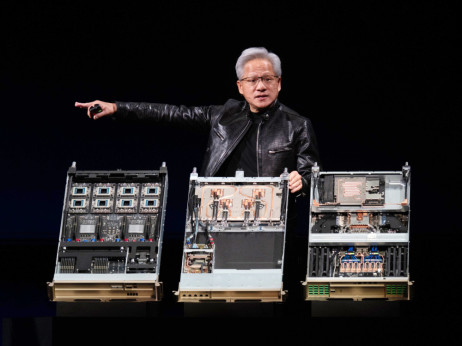

Bloomberg Adria / Velibor Gajović

Poglej Galerijo

Bloomberg Adria / Velibor Gajović

Poglej Galerijo

Bloomberg Adria / Velibor Gajović

Poglej Galerijo

Bloomberg Adria / Velibor Gajović

Poglej Galerijo

A kot pravi, ima ta pristop težave. "Prva je, da je obseg kakovostnih podatkov zelo omejeno. Velika podjetja mesečno porabijo milijone dolarjev za pridobivanje čim več podatkov." Druga težava pa je, doda, da se modeli večinoma trenirajo na "povprečnih" vrednotah, zanemarjajo pa raznolikost med ljudmi.

Preberi še

Ali umetna inteligenca res odžira delovna mesta? Rezultati raziskave so jasni

Umetni inteligenci najbolj izpostavljene panoge beležijo trikrat večjo rast prihodkov na zaposlenega kot panoge, ki so ji najmanj izpostavljene.

11.06.2025

Presečišče prebojnih tehnologij in poslovnega sveta

Na konferenci Future Fusion Summit v Ljubljani so domači in tuji strokovnjaki razpravljali o tem, kako lahko Slovenija izkoristi priložnosti, ki jih prinašata digitalna transformacija in razvoj naprednih tehnologij.

11.06.2025

Financiranje prihodnosti: Kje dobiti kapital za razvoj novih tehnologij?

Na konferenci Bloomberg Adria o iskanju denarja za zagonska tehnološka podjetja.

10.06.2025

Zuckerberg osebno zaposluje novo 'superinteligentno' ekipo

Zuckerberg zaposluje najuglednejše raziskovalce in inženirje umetne inteligence.

10.06.2025

"Če želimo nasloviti to težavo, si lahko ogledamo prevladujočo tehnologijo za usklajevanje modelov: RLHF – okrepljeno učenje na podlagi povratnih informacij ljudi. Zbirajo se človeške preference – ljudje primerjajo odgovore modela in izberejo tiste, ki so jim bolj všeč. Ti podatki se nato uporabijo za učenje t. i. modela nagrajevanja, ki napoveduje človeške preference."

Ta model nagrajevanja se potem uporabi za prilagoditev parametrov LLM-ja tako, da je ta "nagrada" čim bolj privlačna, poudarja Bogunović.

"To je standardni pristop, ki ga za usklajevanje uporablja ChatGPT, vendar je daleč od popolnosti. Kot sem že omenil, obstaja velik problem s podatki. Poleg tega so modeli nagrajevanja pogosto nezanesljivi in lahko okrepijo že obstoječe pristranskosti. In nenazadnje – številne metode optimizirajo zgolj en model nagrajevanja, pri tem pa spregledajo bogastvo človeških vrednot in ciljev."

Kako naprej

Klasičen odgovor se glasi: vse je treba povečati. "Večji modeli, več podatkov, več energije, več računalniške moči. To je sicer ena pot – a ni trajnostna."

Tak pristop poskuša preseči Bogunovićev raziskovalni tim – na problem gledajo kot na sistemsko učenje modela nagrajevanja skozi aktivno interakcijo.

Kar se tiče pluralizma, Bogunović na konferenci poudari, da trenutni modeli poskušajo biti "optimizirani za povprečnega človeka".

"Ko ti modeli postajajo močnejši, morajo biti ne le pametni, ampak tudi zanesljivi – resnično usklajeni s človeškimi vrednotami, hkrati pa energetsko učinkoviti in varčni z viri," sklene.

.png)