Svet je preplavljen z globokimi ponaredki (deepfake) – videi, zvočnimi posnetki in slikami, zaradi katerih se zdi, da so ljudje počeli ali govorili stvari, ki jih niso, ali da so bili nekje, kjer niso bili. Številni globoki ponaredki so ustvarjeni, da bi neresnicam dali verodostojnost ter škodovali ugledu politikov in drugim ljudem v javnosti. Večina globokih ponaredkov je eksplicitnih videoposnetkov in slik, ki so nastali s preslikavo obraza slavne osebe na telo nekoga drugega. To se je zgodilo konec januarja, ko so se po družbenih medijih razširile lažne eksplicitne slike pop zvezdnice Taylor Swift. Zdaj, ko umetna inteligenca skoraj vsakomur omogoča, da z nekaj pritiski na tipkovnico ustvari realistične slike in zvoke, je vse težje ugotoviti, ali je to, kar vidite in slišite na spletu, resnično.

1. Kaj se je zgodilo s Taylor Swift?

Lažne slike Taylor Swift so se na veliko delile na družbenih omrežjih, kar je pri njenih oboževalcih vzbudilo gnev. Veliko se jih je pojavilo na portalu X (nekdaj Twitter), ki je sporočil, da si prizadeva odstraniti vse identificirane slike in da bo sprejel ustrezne ukrepe proti tistim, ki so jih objavili. Ena izmed objav je na X ostala približno 17 ur in imela več kot 45 milijonov ogledov, kot poroča portal Verge, kar pomeni, da lahko te slike postanejo viralne, še preden se sprejme ukrep za njihovo odstranitev. Pozneje je X blokiral vsebino o Taylor in kot odgovor ob iskanju z njenim imenom ustvaril sporočilo: "Nekaj je šlo narobe. Poskusite ponovno naložiti." Zaradi incidenta z zvezdnico je zaskrbljenost izrazila Bela hiša, ki je dejala, da bi moral kongres razmisliti o zakonodaji za obravnavo lažnih slik, ki se širijo po spletu.

2. Kje se še pojavljajo globoki ponaredki?

V začetku januarja je Xochitl Gomez, 17-letna igralka v seriji Marvel, spregovorila o tem, da je na družbenih omrežjih našla seksualno eksplicitne globoke ponaredke s svojim obrazom in da ji ni uspelo doseči, da bi gradivo umaknili, je poročal NBC News. Globoki ponaredki se pojavljajo tudi ob letošnjih predsedniških volitvah v ZDA. Prebivalci New Hampshira so pred predsedniškimi volitvami v državi prejeli robotski klic, ki jih je z glasom predsednika Joeja Bidna pozival, naj ostanejo doma in prihranijo svoj glas za novembrske volitve. Glas je celo izrekel enega od Bidnovih značilnih stavkov: "Kakšen kup neumnosti."

Preberi še

Startupi ignorirajo vlagatelje

Vse več zagonskih podjetij v strahu pred nižjim vrednotenjem njihovih deležev skriva oziroma omeji dostop vlagateljem do pomembnih podatkov o podjetju.

14.03.2024

Kako se v službi spoprijeti s strašljivimi pogovori o politiki?

V tokratni nasvetni rubriki Uvela službena solata: v letu predsedniških volitev bo težko ločiti osebno od političnega

15.03.2024

Odpuščanja kažejo, da službe v IT niso več večne

Zmanjšanje števila zaposlenih je povzročilo zaskrbljenost v panogi IT, ki je bila dolgo del gospodarstva, kjer je bilo delo lahko dostopno, dobro plačano in varno

13.03.2024

Raziskava: Lahko recesije podaljšajo življenje?

Velika recesija leta 2008 je številnim povzročila nepopisno stisko, vendar nove raziskave kažejo, da je številnim Američanom tudi podaljšala življenje.

12.03.2024

Iluzija: nova oblika manifestacije uspeha ali popolna zabloda?

Je delulu le trik vplivnežev za pritegnitev pozornosti, boj z negotovostjo ali nevarna ideja?

10.03.2024

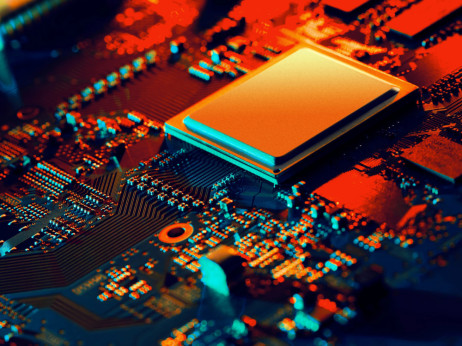

3. Kako nastanejo globoko ponarejeni posnetki

Pogosto so oblikovani z uporabo algoritma umetne inteligence, ki je usposobljen za prepoznavanje vzorcev v resničnih videoposnetkih določene osebe – proces, znan kot globoko učenje. Nato je mogoče zamenjati element enega videa, kot je obraz osebe, z drugo vsebino, ne da bi bilo to videti kot groba montaža. Manipulacije so najbolj zavajajoče, če se uporabljajo s tehnologijo kloniranja glasu, ki zvočni posnetek govorečega razdeli na dele polilogov, ki jih je mogoče sestaviti v nove besede, za katere se zdi, da jih izgovori oseba v izvirnem posnetku.

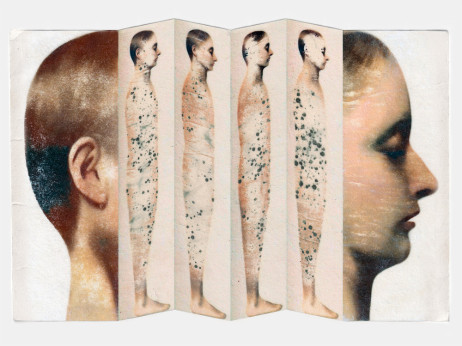

Midjourney

Midjourney

4. Kako je tehnologija globokih ponaredkov vzletela?

Tehnologijo so sprva uporabljali akademiki in raziskovalci. Leta 2017 pa je spletna publikacija Motherboard družbe Vice poročala, da je uporabnik Reddita, imenovan deepfakes, izdelal algoritem za izdelavo lažnih videoposnetkov z uporabo odprte kode. Reddit je uporabnika blokiral, vendar se je vse skupaj razširilo. Na začetku so globoki ponaredki zahtevali videoposnetek, ki je že obstajal, in resnično vokalno izvedbo skupaj s spretnimi veščinami urejanja. Današnji generativni sistemi umetne inteligence pa uporabnikom omogočajo ustvarjanje prepričljivih slik in videov iz preprostih pisnih pozivov. Prosite računalnik, naj ustvari videoposnetek, ki nekomu polaga besede v usta, in prikazal se bo. Digitalne ponaredke je zdaj težje opaziti, saj podjetja z umetno inteligenco uporabljajo nova orodja z ogromno gradiva, ki je na voljo na spletu, vse od YouTuba do knjižnic slik in videoposnetkov.

5. Kateri so drugi primeri globokih ponaredkov?

Kitajski troli so na primer širili prirejene slike avgustovskih požarov na havajskem otoku Maui, da bi podprli trditev, da jih je povzročilo skrivno "vremensko orožje", ki ga preizkuša ZDA. Maja 2023 so tečaji ameriških delnic za kratek čas upadli, ko se je po spletu razširila slika, na kateri je bil prikazan Pentagon v ognju. Strokovnjaki so dejali, da je imela lažna slika znake uporabe umetne inteligence. Februarja istega leta se je pojavil izdelan zvočni posnetek, na katerem je bilo slišati, kako nigerijski predsedniški kandidat Atiku Abubakar načrtuje prirejanje glasovanja tistega meseca. Leta 2021 je bil na družbenih omrežjih objavljen minuto dolg videoposnetek, ki je prikazoval ukrajinskega predsednika Volodimirja Zelenskega, ki je svojim vojakom dejal, naj položijo orožje in se predajo Rusiji.

6. Kakšna je nevarnost?

Obstaja bojazen, da bodo globoki ponaredki sčasoma postali tako prepričljivi, da bo nemogoče ločiti, kaj je resnično in kaj izmišljeno. Predstavljajte si goljufe, ki manipulirajo s tečaji delnic s ponarejenimi videoposnetki izvršnih direktorjev, ki izdajajo najnovejše informacije o podjetju, ali s ponarejenimi videoposnetki vojakov, ki so zagrešili vojne zločine. Politiki, poslovni voditelji in znane osebnosti so še posebno ogroženi, saj je na voljo veliko njihovih posnetkov. Tehnologija omogoča tako imenovano maščevalno pornografijo tudi brez dejanske gole fotografije ali videoposnetka, pri čemer so tarče običajno ženske. Ko posnetek postane viralen na spletu, pa ga je skoraj nemogoče zadržati. Dodatna skrb je, da bodo zaradi širjenja ozaveščenosti o globokih ponaredkih ljudje, ki so resnično ujeti na posnetku, ko počnejo ali govorijo sporne ali nezakonite stvari, lažje trdili, da so dokazi proti njim lažni. Nekateri ljudje se na sodišču že zagovarjajo z globokimi ponaredki.

7. In kakšni so ukrepi proti globokim ponaredkom?

Strojnega učenja, ki ustvarja globoke ponaredke, ni mogoče preprosto ustaviti. Vendar peščica zagonskih podjetij, kot sta Sensity AI s sedežem na Nizozemskem in Sentinel s sedežem v Estoniji, razvija sistem za odkrivanje ponaredkov, ustvarjenih s to tehnologijo. Podobno se težave lotevajo tudi številna velika ameriška tehnološka podjetja. Družba Intel je novembra 2022 predstavila izdelek FakeCatcher, za katerega pravi, da lahko s 96-odstotno natančnostjo zazna ponarejene videoposnetke z opazovanjem subtilnih barvnih sprememb na koži subjekta, ki jih povzroča pretok krvi. Podjetja, vključno z družbo Microsoft, so se zavezala, da bodo v slike, ustvarjene

z njihovimi orodji umetne inteligence, vgradila digitalne podpise, da bi jih razločili kot ponarejene. Zakonodajne oblasti ameriških zveznih držav so se hitreje kot kongres lotile reševanja neposredne škode, ki jo povzroča umetna inteligenca. Več zveznih držav je sprejelo zakone, ki urejajo globoke ponaredke, večinoma v zvezi s pornografijo in volitvami. Predlagani zakon Evropske unije o umetni inteligenci bi od platform zahteval, da globoke ponaredke označijo kot take.

.png)