Jordan Howlett, 26-letnik s 24 milijoni sledilcev na Instagramu, TikToku in YouTubu, je zelo previden pri izbiri blagovnih znamk, s katerimi sodeluje. Podpisal je pogodbe s podjetji Domino‘s Pizza, Google in WingStop ter se preživlja z ustvarjanjem videoposnetkov o tem, kako profesionalno odpreti kozarec za vlaganje in kako pravilno jesti hrano iz restavracije Chipotle. Prav zato se je prestrašil, ko je začel prejemati sporočila z vprašanji, zakaj na Facebooku in Instagramu oglašuje domnevno zdravilo za slepoto.

Howlett je kliknil eno od povezav do omenjenih videoposnetkov in zgroženo prisluhnil glasu, ki je zvenel kot njegov. Opisoval je, kako so vrhunski raziskovalci s Cambridgea odkrili sedem sekundni obred, ki lahko vsakomur omogoči popoln vid. Videoposnetek je bil sestavljen iz slabo zmontiranih rentgenskih posnetkov možganov in ljudi srednjih let, ki s priprtimi očmi gledajo v svoje mobilne telefone, vendar je bil zvok po Howlettovih besedah izjemno prepričljiv. "Ko sem zaslišal svoj glas, sem se zelo prestrašil," pravi. "Teoretično lahko z mojim glasom povedo kar koli."

Strokovnjaki za kibernetsko varnost že več let opozarjajo na globoke ponaredke (deepfake) – umetno ustvarjene ali prirejene medije, ki jih imajo lahko drugi za pristne. Medtem ko je bila večina zaskrbljena zaradi slik in videoposnetkov, je v zadnjem letu postalo jasno, da so najbolj neposredna grožnja ponaredki zvoka, včasih imenovani tudi glasovni kloni. Vijay Balasubramaniyan, ustanovitelj agencije za odkrivanje goljufij Pindrop, pravi, da so že zaznali napade na stranke bank. Goljufi so pri klicih službe za pomoč uporabnikom uporabljajo sintetični zvok, s katerim so se izdajali za imetnike bančnih računov.

Preberi še

7 stvari, ki jih morate vedeti o tehnologiji globokih ponaredkov

O tehnologiji globokih ponaredkov, ki stoji za lažnimi slikami Taylor Swift.

21.03.2024

Ko si startupi ne morejo privoščiti niti prižgane luči

Zaradi naraščajočih stroškov računalništva bosta Google in Microsoft prevladala na področju umetne inteligence.

11.03.2024

Odpuščanja kažejo, da službe v IT niso več večne

Zmanjšanje števila zaposlenih je povzročilo zaskrbljenost v panogi IT, ki je bila dolgo del gospodarstva, kjer je bilo delo lahko dostopno, dobro plačano in varno

13.03.2024

Druga velika grožnja je politična manipulacija. Takšen primer se je zgodil, ko je na primer 20 tisoč volivcev v New Hampshiru prejelo klic domnevnega predsednika Joeja Bidna, v katerem naj bi jih pozval, naj naslednji dan ne volijo zanj. Očitnega praktičnega učinka ni bilo: Bidna sploh ni bilo na glasovnici, a je kljub temu z veliko večino zmagal s pomočjo kampanje za lastnoročen vpis kandidatov. Dogodek je kljub temu okrepil strahove, da bi lahko takšna tehnologija imela pomembno vlogo na letošnjih volitvah. Zvezna komisija za komunikacije (Federal Communications Commission – FCC) je v začetku februarja prepovedala avtomatizirane telefonske kampanje, ki uporabljajo umetno inteligenco.

Podjetje Pindrop je sporočilo, da je bil videoposnetek Howletta ustvarjen tako, da so bili posnetki njegovega govora, ki so bili očitno sestavljeni iz njegovih videoposnetkov na YouTubu ali Instagramu, preneseni v programsko opremo zagonskega podjetja ElevenLabs, ki je klonirala njegov glas. Tehnologija podjetja ElevenLabs je nato uporabniku omogočila, da s Howlettovim glasom ustvari neverjetno prepričljivo zvočno besedilo. Dva druga neodvisna raziskovalca sta analizirala Bidnov robotski klic in ugotovila, da je bil tudi ta zvok ustvarjen s tehnologijo podjetja ElevenLabs.

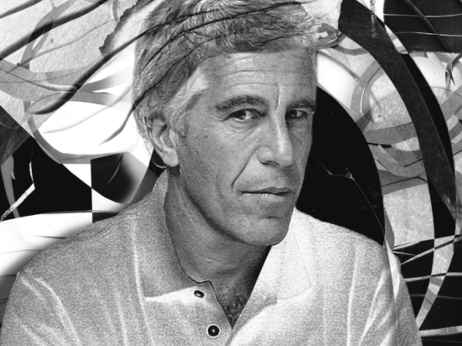

Prijatelja iz otroštva Mati Staniszewski, nekdanji strateg za implementacijo v družbi Palantir Technologies, in Piotr Dąbkowski, nekdanji Googlov inženir na področju strojnega učenja, sta podjetje ElevenLabs ustanovila pred dvema letoma. Oba sta na Poljskem odraščala ob gledanju hollywoodskih filmov, ki so bili nedomiselno sinhronizirani v poljščino, in ugotovila, da bi lahko umetna inteligenca današnjim otrokom prihranila podobno izkušnjo. Razmišljala sta, da bi ista orodja uporabili za spletne učne vsebine v zvočni obliki ali zvočne knjige in celo za prevajanje pogovorov v realnem času.

Ta zamisel je podjetje ElevenLabs spremenila v enega najzanimivejših zagonskih podjetij na področju generativne umetne inteligence. To sicer ni edina storitev za kloniranje glasu, ki je na voljo, vendar se je povzpela na vrh. Podjetje ElevenLabs je zbralo denar od vlagateljev, kot sta Andreessen Horowitziz Smash Capital in soustanovitelj podjetja DeepMind Mustafa Suleyman. V zadnjem krogu financiranja, objavljenem januarja, je bila vrednost podjetja ocenjena na milijardo evrov. Ljudje, ki so seznanjeni z notranjim delovanjem podjetja ElevenLabs, pravijo, da vodstvo ne želi, da bi se njihov izdelek uporabljal za ustvarjanje goljufivega spletnega oglaševanja ali vplivanje na rezultate glasovanja. A kot se pogosto zgodi pri uspešnih spletnih zagonskih podjetjih, so se orodja podjetja razširila hitreje, kot so bili razviti zaščitni ukrepi proti njihovi zlorabi.

Podjetje ElevenLabs ponuja brezplačno knjižnico generičnih glasov, vendar je povpraševanje po klonih prepoznavnih glasov hitro naraslo. Podjetje je kmalu po tistem, ko je januarja 2023 predstavilo orodje, ki je ljudem omogočalo kloniranje glasu s kratkim zvočnim posnetkom, na Twitterju sporočilo, da opaža vse več primerov zlorabe kloniranja glasu. Po takratnem poročanju medijev se je to začelo na spletnem mestu 4chan, kjer so uporabniki delili izseke posnetkov, na katerih sta voditelj podkasta Joe Rogan in igralka Emma Watson uporabljala rasistične in homofobne žaljivke.

Bloomberg Businessweek

Bloomberg Businessweek

Oponašanje zvezdnikov je za podjetje ElevenLabs pomenilo pravno dilemo. Leta 1988 je prizivno sodišče odločilo, da imajo slavne osebe pravico prepovedati komercialno uporabo svojih edinstvenih značilnosti, kot je njihov glas, brez njihovega dovoljenja. (Težava se je prvič pojavila, ko je Bette Midler tožila Ford Motor, ker je najelo pevko, ki je posnemala njen glas, potem ko je sama zavrnila petje v njihovih oglasih.)

Podjetje ElevenLabs je začelo zaračunavati slab evro na mesec za svoje prej brezplačno orodje za kloniranje glasu, da bi zmanjšalo zlorabe. Zaradi tega ustvarjanje zvočnih globokih ponaredkov ni postalo finančno nedostopno, vendar je pomenilo, da so morali uporabniki uporabiti sledljiv način plačila, kot je kreditna kartica, kar bi lahko odvrnilo škodoželjne uporabnike in prispevalo k spoštovanju predpisov.

V podjetju ElevenLabs pravijo, da ne komentirajo posameznih dogodkov, vendar bodo ustrezno ukrepali, če bodo obveščeni o vsebini, ki krši njihove pogoje. Staniszewski je januarja v intervjuju za Bloomberg News dejal, da so skoraj vse uporabe tehnologije tega podjetja zakonite in da lahko ElevenLabs spremlja, katere fraze ustvarjajo uporabniki s kloniranjem glasu. "Za nas je varnost na prvem mestu," je dejal.

Konec leta 2023 je podjetje začelo pripravljati načrt za ukrepanje proti škodoželjnim uporabnikom, je povedala oseba, seznanjena z delovanjem podjetja, ki je želela ostati anonimna. Vodja osebja podjetja ElevenLabs Victoria Weller se je še zlasti osredotočila na postavitev pravil pred uveljavitvijo britanskega zakona o spletni varnosti in evropskega zakona o digitalnih storitvah leta 2024. Želela je oblikovati pravila o žaljivem jeziku in priročnik za zaposlene, da bi bilo slednjim jasno, kdaj lahko uporabniku prepovedo nadaljnjo uporabo. Pravila uporabe podjetja ElevenLabs prepovedujejo "varljive ali zavajajoče glasovne klone« in »vsebino, ki spodbuja nasilje ali promovira sovraštvo". Poudarjajo tudi, da podjetje "proaktivno ne spreminja vsebine uporabnikov v svojih storitvah."

Pet od 40 zaposlenih v podjetju ElevenLabs se ukvarja z zaupanjem in varnostjo. Sogovorniki, ki želijo ostati anonimni, so nam povedali, da si ustanovitelji močno prizadevajo preprečevati morebitne volilne goljufije ali žaljiv govor. Strokovnjaki za umetno inteligenco ter zaupanje in varnost pa pravijo, da je skoraj nemogoče preprečiti ljudem, da bi ustvarjali problematične vsebine z javno dostopnimi orodji za generativno umetno inteligenco. "Tehnološka podjetja si na splošno prizadevajo preprečiti 90 odstotkov škodljivih dejanj," pravi

Mohamed Abdihakim Mohammed, vodja skupnosti, ki je delal na področju moderiranja vsebin v številnih podjetjih za programsko opremo. "Vendar zagonska podjetja dejansko ne morejo narediti ničesar, da bi tehnologiji kloniranja glasu, ki je tako preprosto dostopna, preprečila, da bi povzročila škodo." Bidnov robotski klic je pokazal meje tehnične zaščite podjetja ElevenLabs. Podjetje ponuja orodje, ki ga imenuje klasifikator govora in zanj pravi, da lahko ugotovi, ali je zvočni posnetek sintetičen in ali je bil ustvarjen z njegovo programsko opremo. Tako Bloomberg Businessweek kot Pindrop sta s tem orodjem proučila enega od Bidnovih posnetkov, pri čemer je tehnologija navedla, da ne gre za globoki ponaredek. Podobna orodja drugih podjetij so pokazala nasprotno, po odstranitvi šumov iz ozadja posnetka pa je tudi orodje podjetja ElevenLabs ugotovilo, da je bila njegova tehnologija vendarle uporabljena.

Ta ugotovitev torej kaže, da so orodja za odkrivanje globokih ponaredkov manj zanesljiva, bolj ko so oddaljena od vira. Ustvarjalci lahko dodajo šum ali druge motnje in jih tako prelisičijo. Dosedanji rezultati projektov preverjanja dejstev v družbenih medijih prav tako kažejo, da bi imelo popolno odkrivanje omejen učinek. Ko nekdo posname zvočni posnetek, se lahko ta razširi po družbenih omrežjih, zavajajoča vsebina pa pogosto doseže občinstvo, ki ni pripravljeno verjeti tistim, ki trdijo, da je gradivo, ki jim je všeč, nelegitimno.

Enega od lažnih Howlettovih videoposnetkov si je ogledalo približno 121 tisoč ljudi. "Več takšnih posnetkov bi mi lahko preprečilo prihodnje poslovne priložnosti," pravi. Skrbi ga tudi, da bodo njegovi oboževalci izpostavljeni nevarnosti goljufije. "Ne želim, da bi bili moji sledilci žrtve goljufije," pravi.

Bloomberg Businessweek

Bloomberg Businessweek

In potem nas čakajo še volitve leta 2024. Ustvarjalci globokih ponaredkov navdušeno raziskujejo možnosti. Eden od njih je Samin Yasar, ustvarjalec vsebin na YouTubu in ustanovitelj storitve AI Answers, ki si prizadeva z umetno inteligenco nadomestiti klicne centre. Januarja je Yasar objavil videoposnetek, v katerem pravi, da je v imenu dveh političnih kampanj kloniral glasove s pomočjo tehnologije podjetja ElevenLabs.

Navdih za videoposnetek je bil pogovor z Adamom Wynnsom, podjetnikom, ki se je v preteklosti ukvarjal s solariji. Adam je ustanovil podjetje The Winningest, ki ponuja življenjsko svetovanje in tablete za hujšanje. Wynns je Yasarja vprašal, ali je mogoče ustvariti obsežno avtomatizirano politično telefonsko kampanjo, s katero bi od volivcev zbirali informacije o glasovanju. Yasarju je rekel, da pozna ljudi, ki bi jim lahko ta tehnologija prišla prav.Yasar je za dokazovanje koncepta uporabil tehnologijo podjetja ElevenLabs in kloniral glas Mika Lindella, izvršnega direktorja podjetja MyPillow, ki je aktiven na desnici. Podjetje Dominion Voting Systems, ki izdeluje naprave za štetje glasov, ga zdaj toži za 1,2 milijarde evrov zaradi lažnih trditev o predsedniških volitvah leta 2020. Lindell je zanikal kakršno koli krivdo. "Trdno sem prepričan, da moramo podrobno pregledati naše volilne sisteme in zagotoviti preglednost," je v skladu z vzorcem, ki ga je preveril Businessweek, dejal v zvočnem posnetku, katerega besedilo je bilo ustvarjeno z orodjem ChatGPT. "Osredotočam se na preiskovanje nepravilnosti."

Yasar je zvočni posnetek naložil v storitev robotskega klicanja. Lažni Lindell bi lahko odgovarjal na vprašanja in komentarje volivcev podobno kot avtomatizirani klic službi za pomoč strankam.

Wynns pravi, da je idejo predstavil Lindellu in Scottu Jensenu, nekdanjemu republikanskemu kandidatu za guvernerja Minnesote, ki so ga kritizirali zaradi širjenja lažnih informacij o covidu 19. Odgovora ni nikoli dobil in je nazadnje opustil zamisel, preden bi komercializiral tehnologijo, saj so ga začela skrbeti morebitna pravna vprašanja. Vendar ga z vidika tehnike nič ne bi moglo ustaviti.

Pri pripravi članka je sodeloval Mark Bergen – Bloomberg Businessweek

.png)